Die Anatomie der unsichtbaren Krise: Warum statisches Risikomanagement Vorstände blendet.

Es war ein Dienstag im März, als die Welt für den CEO eines globalen Logistikkonzerns stillstand. Auf seinem Tablet leuchtete das monatliche Risk-Dashboard. Ein vertrauter Anblick: 14 grüne Indikatoren, drei gelbe, kein einziger roter. Die «Heatmap» signalisierte thermische Stabilität.

Sechs Stunden später brach die Lieferkette in Südostasien zusammen. Was als «gelbes» IT-Problem (eine kleine Verzögerung bei der Software-Aktualisierung in einem regionalen Hafen) begann, kaskadierte innerhalb von Stunden in ein vom System als «grün» verkanntes Personalproblem (Überlastung der Schichtleiter) und endete in einer «roten» Liquiditätskrise, als Konventionalstrafen fällig wurden.

«Warum haben wir hunderte Experten und teure Software, wenn uns am Ende die simpelste Kausalkette blind erwischt?»

Die Antwort ist so schmerzhaft wie trivial: Wir verwalten Risiken in Silos. Wir behandeln sie wie Zeilen in einer Excel-Tabelle, die brav nebeneinander existieren. Doch in der Realität verhalten sich Risiken wie ein biologisches Ökosystem. Sie kommunizieren. Sie mutieren. Und sie kaskadieren.

Das Kaskaden-Paradoxon: Die Grenzen des linearen Denkens

Im klassischen Management-Training lernen wir, Risiken nach Eintrittswahrscheinlichkeit und Schadenshöhe zu bewerten. Dieses Modell stammt aus einer Zeit, in der die Welt weniger vernetzt war. Heute jedoch leben wir im Zeitalter der «Polykrise». Ein Risiko tritt selten allein auf; es ist meist der Katalysator für das nächste.

Das menschliche Gehirn ist ein hervorragendes Instrument für lineare Kausalität (A führt zu B). Es scheitert jedoch kläglich an mehrdimensionalen Abhängigkeiten (A schwächt C, was B instabil macht, während D gleichzeitig die Ressourcen von A abzieht).

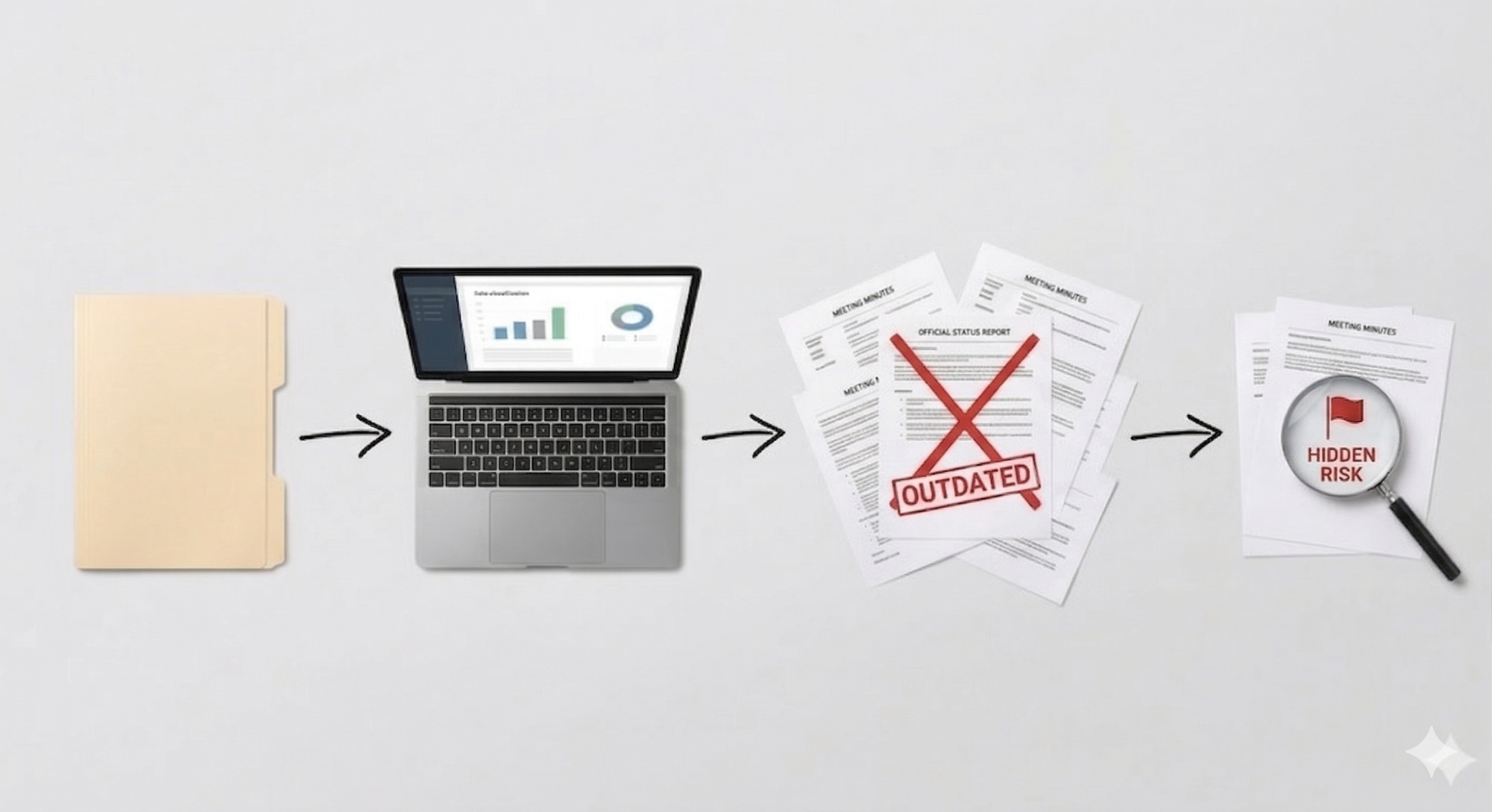

Hier setzen wir traditionell auf komplexe Simulationssoftware. Doch diese hat einen entscheidenden Nachteil: Sie ist starr. Sie basiert auf Annahmen, die Programmierer Monate zuvor getroffen haben. In einer sich stündlich ändernden geopolitischen und technologischen Lage ist diese Software oft veraltet, noch bevor der Bericht gedruckt ist.

Hier tritt NotebookLM auf den Plan, nicht als ein weiteres Tool zur Textzusammenfassung, sondern als ein dynamischer Kaskaden-Simulator für die strategische Ebene.

Vom «Source Engineering» zur kognitiven Immunität

Der entscheidende Fehler, den die meisten Anwender bei KI machen, ist der Glaube, die Maschine besässe «Magie». Sie erwarten, dass sie ein poliertes Risk-Report-PDF hochladen und die KI ihnen sagt, was zu tun ist. Das ist ein Trugschluss. Wenn Sie polierte Berichte hochladen, erhalten Sie polierte (und damit nutzlose) Antworten.

Um echte Kettenreaktionen vorherzusehen, müssen wir das Prinzip des «Raw Data Injections» anwenden.

Phase 1: Die Aggregation ungeschönter Signale

Anstatt der KI die fertigen Schlussfolgerungen Ihrer Abteilungsleiter zu geben, füttern wir sie mit dem «Lärm» unterhalb der Oberfläche.

Laden Sie die rohen Audit-Logs der IT hoch.

Laden Sie die unredigierten Transkripte der letzten Kundenbeschwerde-Calls hoch.

Laden Sie Exporte aus den operativen Teams (anonymisiert auf Rollenebene) hoch.

Laden Sie aktuelle geopolitische Makro-Analysen hinzu.

Ein kritischer Hinweis zur Gouvernanz: Wir bewegen uns hier im Bereich hochsensibler Unternehmensdaten. Für diese Art der tiefen Analyse ist die Nutzung der Google Workspace Enterprise-Lösung zwingend erforderlich. Nur in dieser isolierten Umgebung ist sichergestellt, dass Ihre internen Daten nicht zum Training globaler Modelle verwendet werden und innerhalb Ihrer organisatorischen Hoheit verbleiben. Datensicherheit ist hier kein «Nice-to-have», sondern das Fundament Ihrer intellektuellen Souveränität.

Phase 2: Die Methode des Kaskaden-Prompts

NotebookLM glänzt durch seine Fähigkeit, innerhalb eines geschlossenen Kontexts (Ihrem «Grounding») Verbindungen herzustellen, die ein menschlicher Analyst in der Menge der Daten übersehen würde.

Anstatt zu fragen: «Fasse die Risiken zusammen», nutzen wir explorative Stress-Tests. Ein Beispiel Prompt-Protokoll sieht so aus:

«Simuliere folgendes Ereignis: Ein Ausfall unseres Hauptlieferanten für Komponente X über 14 Tage. Verknüpfe dieses Ereignis mit den hochgeladenen HR-Daten zur Personalfluktuation und den IT-Sicherheitsprotokollen. Identifiziere die dritte Ebene der Kaskade: Welche Abteilung, die scheinbar nichts mit der Lieferkette zu tun hat, wird als erste strukturelle Risse zeigen? Begründe dies ausschlieslich mit Zitaten aus den Rohdaten.»

Der «Aha»-Moment entsteht, wenn die KI aufzeigt, dass beispielsweise die Marketing-Abteilung kollabiert, weil dort aufgrund einer Software-Umstellung (IT-Log) und hoher Fluktuation (HR-Bericht) die Kapazität fehlt, um die Kundenkommunikation im Krisenfall (Lieferausfall) aufzufangen. Ein Zusammenhang, der in keiner statischen Heatmap auftaucht.

Die Rolle des Vorstands

Wenn Sie mit diesen Erkenntnissen in den Aufsichtsrat oder die Vorstandssitzung gehen, besteht die Gefahr, dass die KI-Analyse als «Maschinen-Panik» abgetan wird. Um dies zu vermeiden, müssen wir die Rolle der KI neu definieren.

Die KI liefert nicht die Wahrheit. Sie liefert die Fragen, die gestellt werden müssen.

Anstatt zu sagen:

«Die KI sagt, wir haben ein Problem im Marketing», positionieren Sie das Ergebnis als strategischen Stress-Test: «Unsere Kaskaden-Simulation zeigt eine kritische Abhängigkeit zwischen IT-Migration und Kundenreklamations-Kapazität auf. Herr Marketingvorstand, wie robust ist Ihr Team gegen ein 300% höheres Anrufaufkommen während der kommenden Software-Umstellung?»

NotebookLM verwandelt den Vorstand vom passiven Empfänger kuratierter (und oft beschönigter) Informationen in einen aktiven Auditor der Unternehmensstruktur. Sie nutzen die KI, um die «glatte» Oberfläche der Corporate Narrative aufzukratzen und die darunterliegenden Bruchstellen freizulegen.

Risikomanagement als Offensive

Risikomanagement wird oft als defensive Compliance-Übung missverstanden. Das ist ein strategischer Fehler. In einer volatilen Welt ist das Verständnis von Kaskaden ein Instrument der Offensive. Wer Kettenreaktionen sechs Monate früher sieht als der Wettbewerber, baut keine Mauern er baut Brücken. Er kann Ressourcen umleiten, während die Konkurrenz noch versucht, die Ursache der ersten Dominosteine zu begreifen.

Die Technologie von NotebookLM ermöglicht uns eine Form der «Vorausschau durch Synthese», die bisher Armeen von Analysten vorbehalten war. Doch der Hebel liegt nicht im Algorithmus. Er liegt in Ihrer Bereitschaft, die KI mit den unbequemen Rohdaten zu füttern und die unbequemen Fragen zu stellen.

Ihre 15-Minuten-Challenge für morgen früh

Nehmen Sie ein Projekt, das Sie derzeit als «stabil» betrachten.

Erstellen Sie ein privates Notebook in Ihrer Enterprise-Umgebung.

Laden Sie nicht den Projektstatusbericht hoch, sondern die letzten drei Sitzungsprotokolle der operativen Ebene und die zugehörige E-Mail-Korrespondenz.

Fragen Sie: «Welches operative Detail wird hier konsistent erwähnt, aber in seiner Auswirkung auf den finalen Meilenstein ignoriert?»

Mit besten Grüssen,