Das «House of AI» | Regulierung & die pragmatischen ersten Schritte

Als CEO eines mittelständischen Unternehmens haben Sie zwei KI-Projekte auf dem Tisch. Projekt A: Ihr Team entwickelt ein eigenes, KI-System zur Produktionssteuerung. Projekt B: Sie führen Microsoft Copilot (ISO 42001 zertifiziert) im gesamten Unternehmen ein. Intuitiv ist klar: Die Verantwortung in Projekt A ist ungleich grösser. Doch wie genau teilt sich diese Verantwortung auf? Und was bedeutet das für Unternehmen, die wie in Projekt B primär fertige KI-Systeme einkaufen und anwenden?

In der Debatte um den EU AI Act dominieren komplexe Begriffe wie QMS, technische Dokumentation und Konformitätsbewertung. Diese aktiven Pflichten liegen fast ausschliesslich beim Anbieter. Die weitaus grössere Gruppe der Betreiber ist davon jedoch indirekt betroffen: Sie müssen sicherstellen, dass diese Nachweise vorliegen, und das System strikt nach den daraus resultierenden Anweisungen nutzen.

Das Governance-Gebäude

Um die verschiedenen Regularien, insbesondere für Hochrisiko-KI-Systeme, zu verorten, bleibt unser Gebäude ein nützliches Modell. Die entscheidende Neuerung ist die Trennung der Verantwortlichkeiten (Anbieter vs. Betreiber) auf den Ebenen 0-4.

Gebäude (Modell)

Als Betreiber sind Sie nicht für den Bau des Hauses verantwortlich. Sie müssen aber sicherstellen, dass Sie in ein sicher gebautes Haus einziehen und es gemäss der Bauanleitung nutzen und Instandhaltern.

Ihre Pflichten als Betreiber nach Artikel 26 EU AI Act

Wenn Sie ein Hochrisiko-KI-System nutzen, haben Sie als Betreiber klar definierte Pflichten. Diese sind deutlich schlanker als die des Anbieters, erfordern aber dennoch Ihre volle Aufmerksamkeit. Ihre Aufgaben sind unter anderem:

Gebrauchsanweisung befolgen: Sie müssen das KI-System streng nach den Vorgaben des Anbieters nutzen. Das klingt trivial, ist aber die zentrale Anforderung. Weichen Sie davon ab, können Sie selbst zum Anbieter mit allen Pflichten werden.

Menschliche Aufsicht sicherstellen: Sie müssen kompetente und geschulte Mitarbeiter benennen, die das System überwachen und seine Ergebnisse interpretieren können. Eine KI darf nie ohne menschliche Kontrollinstanz agieren.

Input-Datenqualität prüfen: Daten kontrollieren, die in das System fliessen, müssen Sie sicherstellen, dass diese für den Zweck relevant und repräsentativ sind. «Garbage in, garbage out» gilt auch hier.

Mitarbeiter und Betroffene informieren: Sie müssen Ihre Mitarbeiter über den Einsatz des Systems informieren. Ebenso müssen Sie die Personen informieren, die von den Entscheidungen des Systems betroffen sind (z.B. Bewerber).

Datenschutz-Folgenabschätzung (DSFA) durchführen: Wenn das System personenbezogene Daten verarbeitet, müssen Sie eine DSFA durchführen. Die dafür nötigen Informationen, muss Ihnen der Anbieter zur Verfügung stellen.

Diese und weitere Pflichten erfordern Prozesse und Sorgfalt.

Die Pflichten des Anbieters nach Artikel 16ff EU AI Act

Im Gegensatz zum Betreiber ist der Anbieter für das Design, die Entwicklung und die Konformität des KI-Systems verantwortlich. Seine Pflichten sind ungleich grösser und umfassen unter anderem:

Aufbau eines Qualitätsmanagementsystems (QMS): Hier kommt die prEN 18286 (im Werden) ins Spiel. Der Anbieter muss ein QMS etablieren, das den gesamten Lebenszyklus des KI-Systems abdeckt.

Erstellung der technischen Dokumentation: Der Anbieter muss detailliert dokumentieren, wie das System funktioniert, wie es trainiert wurde und wie es validiert wurde.

Durchführung der Konformitätsbewertung: Der Anbieter muss nachweisen, dass sein System die Anforderungen des EU AI Act erfüllt und eine CE-Kennzeichnung anbringen.

Bereitstellung der Gebrauchsanweisung: Er muss dem Betreiber eine klare und verständliche Anleitung zur Verfügung stellen.

Diese und weitere Pflichten erfordern Prozesse und Sorgfalt.

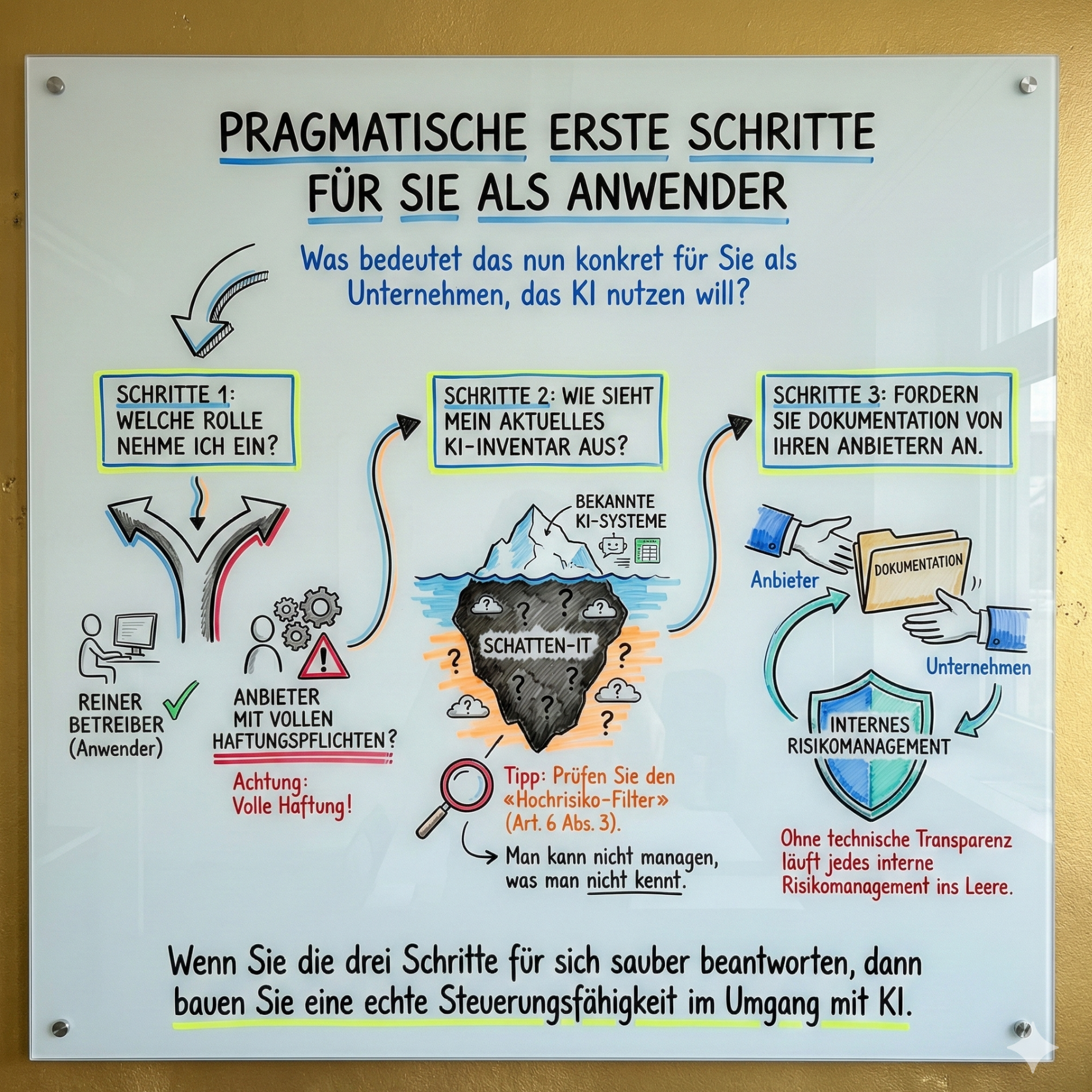

Pragmatische erste Schritte für Sie als Anwender

Erste Schritte

Schritt 1: Welche Rolle nehme ich ein?

Bin ich reiner Betreiber oder werde ich durch Modifikation zum Anbieter mit vollen Haftungspflichten?

Welches Recht gilt? Prüfen Sie, ob Ihr System den EU-Markt berührt («Extraterritoriale Wirkung»)

Schritt 2: Wie sieht mein aktuelles KI-Inventar aus?

Listen Sie alle KI-Systeme auf, die Sie nutzen. Oft ist die Schatten-IT grösser als bekannt, man kann nicht managen, was man nicht kennt.

Tipp: Prüfen Sie den «Hochrisiko-Filter» (Art. 6 Abs. 3).

Schritt 3: Fordern Sie Dokumentation von Ihren Anbietern an.

Ohne die technische Transparenz läuft jedes interne Risikomanagement ins Leere.

Konzentrieren Sie sich auf Ihre Rolle

Sie müssen nicht das ganze Haus bauen. Sie müssen aber ein guter und sorgfältiger Hausverwalter sein. Konzentrieren Sie sich auf Ihre Pflichten als Betreiber gem. Art 26. Überwachen Sie das System, schulen Sie Ihre Mitarbeiter und dokumentieren Sie Ihre Aktivitäten.

Herzlichst

Peter Duliba

Termin buchen: https://calendly.com/peter-duliba/one-to-one

Rechtlicher Hinweise & Haftungsausschluss

1. Keine Rechtsberatung Die Inhalte dieses Dokuments dienen ausschliesslich allgemeinen Informationszwecken und stellen keine Rechtsberatung dar.

2. Dynamische Rechtslage (EU AI Act & Standards) Bitte beachten Sie, dass sich der regulatorische Rahmen für Künstliche Intelligenz in der EU in einer dynamischen Entwicklungsphase befindet.

Gesetzesänderungen: Durch laufende Gesetzgebungsverfahren (z. B. «Digital Omnibus») können sich Fristen, Definitionen und Pflichten, insbesondere für Hochrisiko-KI-Systeme, noch verschieben oder ändern.

Technische Standards: Verweise auf Normen. Da einige der Normen (z. B. prEN 18286, ISO/IEC 42001) sich noch im Entwurfsstadium befinden oder noch nicht im Amtsblatt der EU harmonisiert wurden, können sich die endgültigen Anforderungen unterscheiden.

3. Bei den Inhalten handelt es sich um didaktisch aufbereitete Darstellung juristischer Artikel (z. B. Art. 16 und Art. 26 EU AI Act). Dies dient der Verständlichkeit und erhebt keinen Anspruch auf juristische Vollständigkeit.